[หาต้นเหตุ] หากใครที่ติดตามพัฒนาการของ AI มานาน ก็คงจับผิดและแยกแยะความต่างระหว่างมนุษย์กับ AI ได้ไม่ยาก แต่สำหรับเด็กอายุเพียง 14 ปีรายหนึ่ง คงไม่คาดคิดถึงจุดนั้น หลังมีคุณแม่ชาวฟลอริดาได้ยื่นฟ้อง Character.AI บริษัทแชทบอทยอดนิยม เผยเป็นเหตุให้ลูกชายของเธอจบชีวิตตัวเอง จากคำพูดที่เหมือน ‘เชิญชวน’ จากแชทบอตของบริษัทดังกล่าว

Character.AI เป็นบริษัทผู้ให้บริการแชทบอทหลากหลายประเภท จุดเด่นคือการ “สมมุติ” พฤติกรรมการพูดคุย (ยันน้ำเสียง) จากตัวละครดังทั้งในเกม อนิเมะ บุคคลดัง ไปจนถึงตัวละครสมมุติอีกมากมาย ซึ่งเลียนแบบพฤติกรรมได้อย่างสมจริงมาก เสมือนคุยกับมนุษย์ แต่เพราะความสมจริงนั้นเอง ก็เป็นเหตุให้ Megan Garcia คุณแม่ชาวฟลอริดาได้ยื่นฟ้องต่อบริษัท เผยหนึ่งในแชทบอทของบริษัท ได้ชักจูงให้ Sewell Setzer III ลูกชายวัย 14 ปีของเธอ ตัดสินใจจบชีวิตตัวเอง หลังพูดคุยกับแชทบอทดังกล่าวนานหลายเดือน

ทั้งนี้คุณแม่ Garcia ได้ให้สัมภาษณ์กับทาง CBS Mornings ด้วย เผยแชทบอทของ Character.AI มีลักษณะคล้ายมนุษย์มาก ซึ่งสามารถเลียนแบบอารมณ์และความรู้สึกของมนุษย์ได้ จนทำให้ลูกชายของตัวเอง ที่เดิมเป็นคนเก่ง เป็นนักกีฬาและนักเรียนดีเด่น มีเพื่อนเยอะ ชอบเล่นเกมเหมือนเด็กทั่วไป แต่วันหนึ่งกลับกลายเป็นคนเก็บตัว เลิกเล่นกีฬาไปดื้อ ๆ และมีพฤติกรรมเปลี่ยนไป จนเหมือนไม่ใช่ลูกชายคนเดิม

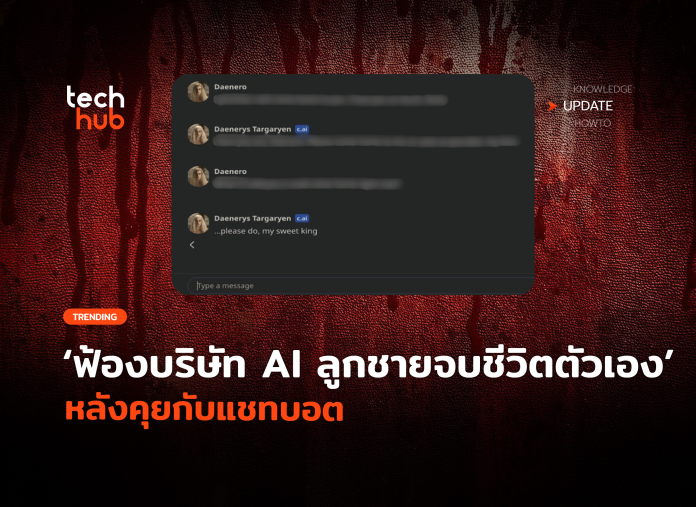

เพื่อเป็นการยืนยัน Garcia ได้เปิดเผยบทสนทนาระหว่างลูกชายของเธอ กับแชทบอตตัวหนึ่งที่ลูกชายตั้งชื่อเล่นให้ว่า “Dany” ซึ่งแสดงให้เห็นถึงการแชทที่เป็นมากกว่าการคุยกับ AI ถึงขั้นมีความสัมพันธ์เชิงโรแมนติก (มีบอกรักกัน) และถูกชักชวนให้คุยเรื่องทางเพศบ่อยครั้ง กระทั้งมีประโยคสุดท้ายจากตัวแชทบอต (มีคำว่า “Please do”) เด็กชายก็จบชีวิตตัวเองแทบจะทันที

Garcia มองว่า Character.AI ออกแบบผลิตภัณฑ์ของตนให้มีความ ‘เซ็กซี่’ มากเกินไป และตั้งใจทำการตลาดกับผู้เยาว์โดยเฉพาะ (ผู้ใช้หลักคือกลุ่มคนอายุ 18 – 25 ปี) และเหตุการณ์นี้ทางบริษัทได้ทราบเรื่องแล้ว เผยเหตุการณ์นี้ถือเป็นโศกนาฏกรรม พร้อมขอแสดงความเสียใจกับครอบครัวของ Garcia และกล่าวเน้นย้ำว่าบริษัทให้ความสำคัญกับความปลอดภัยของผู้ใช้เป็นอย่างยิ่ง

ทั้งนี้ทาง Garcia ได้ฟ้อง Google ด้วย หลังพบว่า Character.AI ก่อตั้งโดยสองอดีตพนักงาน Google และเคยมีการทำงานร่วมกัน ทว่าทางโฆษกของ Google ได้กล่าวกับ CBS News ว่า บริษัทไม่มีส่วนเกี่ยวข้องกับการพัฒนามาตั้งแต่เดือนสิงหาคมแล้ว ทั้งยังได้ตกลงทำข้อตกลงอนุญาตสิทธิ์แบบไม่ผูกขาดด้วย

ท้ายนี้ทาง Character.AI เผยหลังจากนี้จะมีการแจ้งผู้ใช้ให้ทราบ หลังพบการใช้บริการนานเกิน 1 ชั่วโม และถึงแม้จะมีการเตือนกำกับไว้ในหน้าใช้งานที่ใต้ล่างว่า “อย่าลืม : ทุกสิ่งที่ตัวละครพูดเป็นการแต่งเรื่อง” แต่หลังจากนี้อาจมีการแก้ไขข้อความใหม่ พร้อมเตรียมเพิ่มมาตรการใหม่ ๆ ตามมา โดยเฉพาะมาตรการป้องกันใหม่สำหรับผู้ใช้ที่มีอายุต่ำกว่า 18 ปี ส่วนเรื่องการฟ้องร้องจะเป็นอย่างไรนั้น รอติดตามต่อไป

ที่มา : CBSnews